AI: da Asimov a Interoperabilità per una politica umana dell’AI

Contenuti

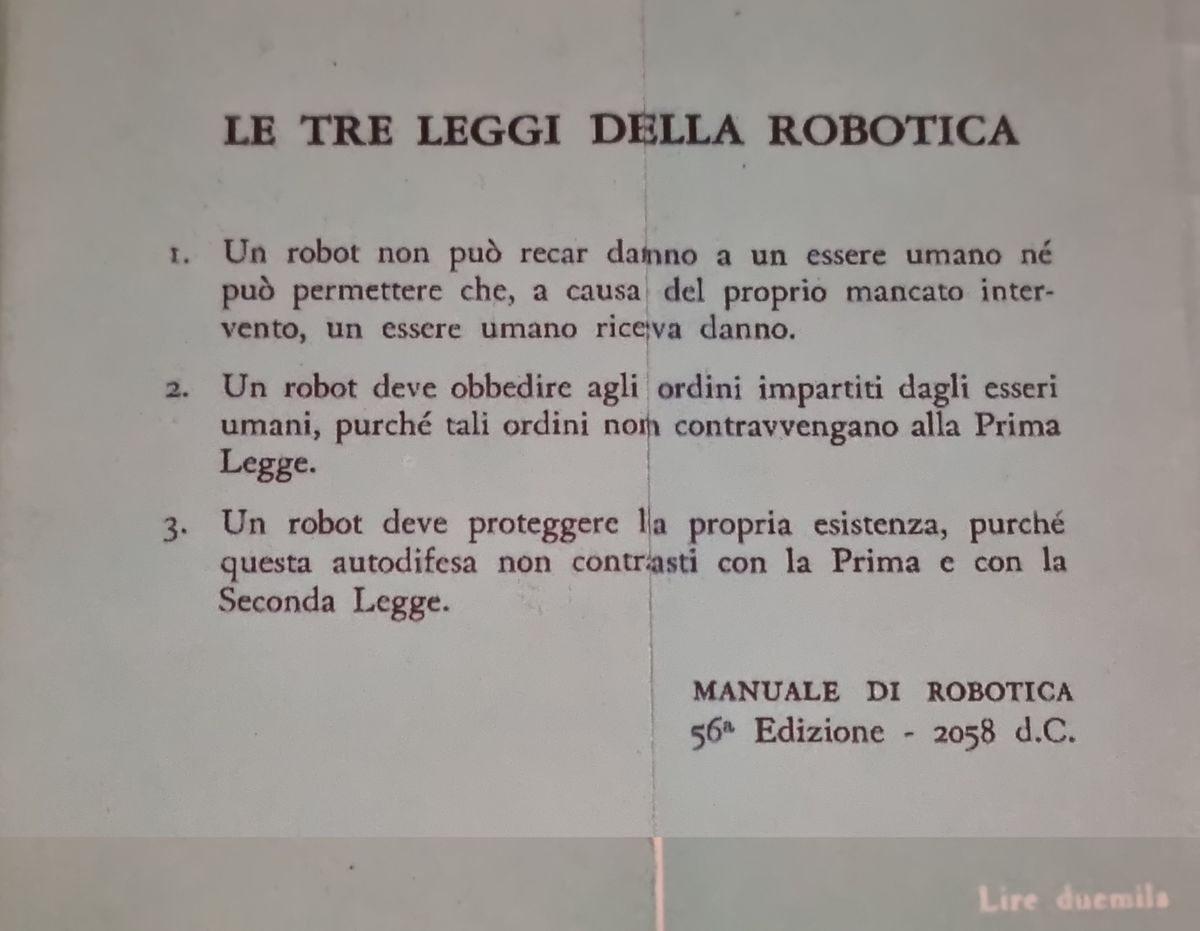

Mi piace ricondurre al 1950 e alla pubblicazione di Io, Robot di Isaac Asimov il primo tentativo umano di regolamentare l’intelligenza artificiale. In realtà Asimov aveva introdotto le tre leggi della robotica già nel racconto del 1941 Circolo vizioso, poi inserito nella raccolta di racconti di fantascienza Io, Robot.

C’erano stati in passato precedenti letterari in cui erano presenti automi (quelli di Omero nell’Iliade per esempio), golem o altri personaggi assimilabili a Robot ma Asimov, seppur nella forma del racconto di fantascienza, è il primo che pone in modo strutturato e scientifico il problema etico dell’interazione tra l’uomo e un’intelligenza artificiale.

Trovo assolutamente moderne e attuali la prima e la seconda di queste leggi perché vanno al cuore dell’attuale discussione su come regolamentare l’utilizzo dell’intelligenza artificiale all’interno delle interazioni sociali umane. Ovviamente oggi il termine robot va inteso in senso largo estendendolo a qualunque algoritmo che, utilizzando e apprendendo dai dati, interagisce e influenza il comportamento degli esseri umani. Per fare un esempio concreto: l’algoritmo con cui un social network ci presenta le notizie o i post da leggere è per me, a tutti gli effetti, un robot.

Che danno può farci l’AI?

Non è invece facile definire il concetto di danno ricevuto da un essere umano, citato nella prima legge, ma porsi il problema è eticamente necessario includendo nel concetto di danno sia la sua declinazione fisica che, soprattutto quella psicologica. Più facile, allo stato attuale dell’evoluzione dell’intelligenza artificiale, ragionare sulla necessità del robot (algoritmo) di ubbidire agli ordini impartiti dagli uomini. Oggi possiamo dire che lo fanno e che siamo ancora molto lontano dall’intelligenza artificiale forte. Ci sono due criticità riconducibili alla seconda legge e che stanno già emergendo:

- La prima è che spesso gli algoritmi di oggi “obbediscono agli ordini” di troppo pochi umani, cioè sono spesso sotto il controllo di poche organizzazioni e realizzati all’interno di queste organizzazioni da poche persone.

- La seconda criticità è che, soprattutto all’interno del deep learning, l’interpretabilità delle logiche e delle scelte di questi algoritmi (ordini usando il linguaggio di Asimov) è difficile e, nel caso si riesca ad averla, ad appannaggio di pochi adepti.

Proprio per superare queste problematiche la politica, intesa come capacità di indirizzare le scelte della società per il meglio, e l’etica sul piano individuale e collettivo possono essere di grande aiuto. In questo blog mi voglio occupare proprio di politica, etica e di come l’intelligenza artificiale stia modificando la società, perché ritengo che questi temi stiano influenzando e influenzeranno il nostro futuro in maniera più forte di quanto possiamo pensare oggi.

Regolamentare l’Intelligenza Artificiale

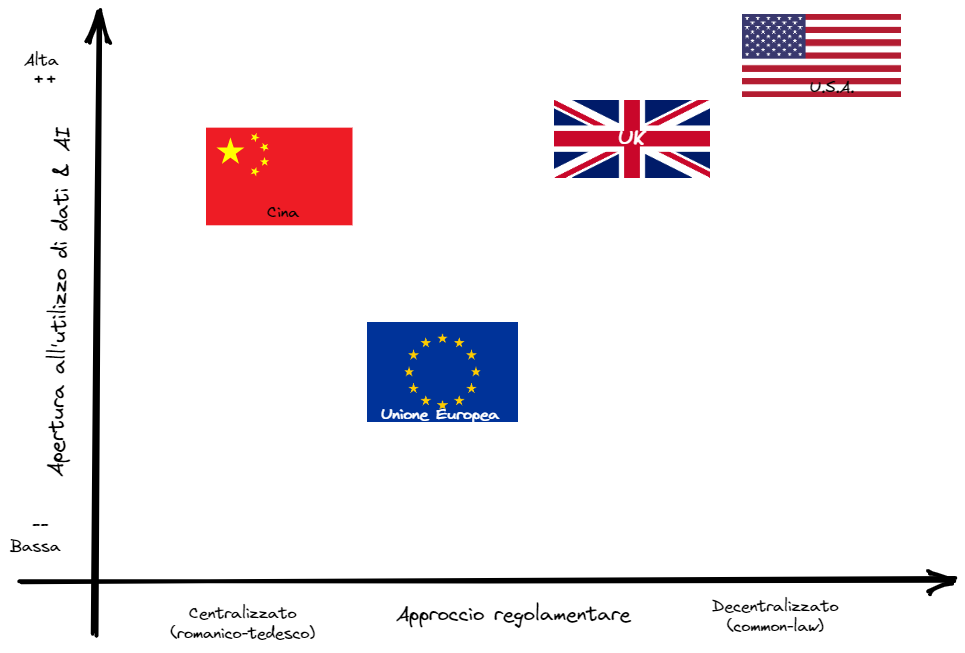

In Europa, per esempio, ad Aprile 2021 è uscita la prima proposta di regolamentazione dell’intelligenza artificiale. Ci torneremo per commentarla in un post dedicato ma possiamo già dire che, da una parte rappresenta un tentativo di avere un approccio comune almeno a livello europeo sul tema, ma dall’altra evidenzia una grossa difficoltà nel normare in termini concreti questi aspetti e soprattutto delinea una visione sull’AI molto differente rispetto a quello che avviene in altre aree del mondo. L’aspetto dell’interoperabilità, che la bozza dell’Unione Europea si evidenza come uno degli scopi primari della regolamentazione per favorire anche l’allargamento del mercato a livello europeo, è molto critico se lo vediamo proprio su scala mondiale. Infatti, come ho cercato di schematizzare nell’immagine sotto, gli approcci sono molto diversi.

L’Unione Europea è per certi versi pioniera e per altri cavia degli aspetti normativi del mondo della tecnologia e il tema dell’uso dell’intelligenza artificiale ne è un esempio. Caratteristica, figlia dell’approccio europeo di diritto romano-germanico, che si contrappone a quello anglosassone basato maggiormente sui precedenti giurisprudenziali. E infatti la regolamentazione dell’uso dei dati e algoritmi è molto più bassa, almeno ex-ante, sia in UK che negli Stati Uniti. Questo favorisce da una lato l’evoluzione sia sul piano tecnologico che economico del settore ma dall’altro espone cittadini e imprese a rischi sui temi di sicurezza, etica e privacy, che secondo l’approccio common-law, vanno mitigati maggiormente ex-post.

La Cina, un mondo a parte

Un mondo a parte è rappresentato dalla Cina il cui approccio più centralizzato e per molti versi spregiudicato arriva da un ambito socio-culturale che privilegia l’interesse della comunità rispetto alla libertà individuale, sotto il forte influsso del confucianesimo. E nell’ambito dell’applicazione dell’intelligenza artificiale questo ha portato a risultati molto diversi visto che il social credit scoring sta avendo la sua applicazione su larga scala in Cina mentre risulta tra le applicazioni esplicitamente vietate nella bozza del regolamento europeo menzionato prima. Apparentemente l’approccio cinese sembra avere, dal punto di vista industriale e dell’evoluzione della tecnologia, un vantaggio palese. Resta il fatto che tenere l’uomo ai margini di sistemi decisionali così impattanti per la sua vita e per il suo futuro socio-economico non mi sembra essere una scelta molto sostenibile nel medio-lungo periodo.

Il tema è molto complesso ed in equilibrio instabile tra sicurezza e benefici che possano derivare dall’utilizzo di dati e algoritmi. Discuterne è parte della soluzione soprattutto se si riesce a trovare una sintesi il più pragmatica e globale possibile.